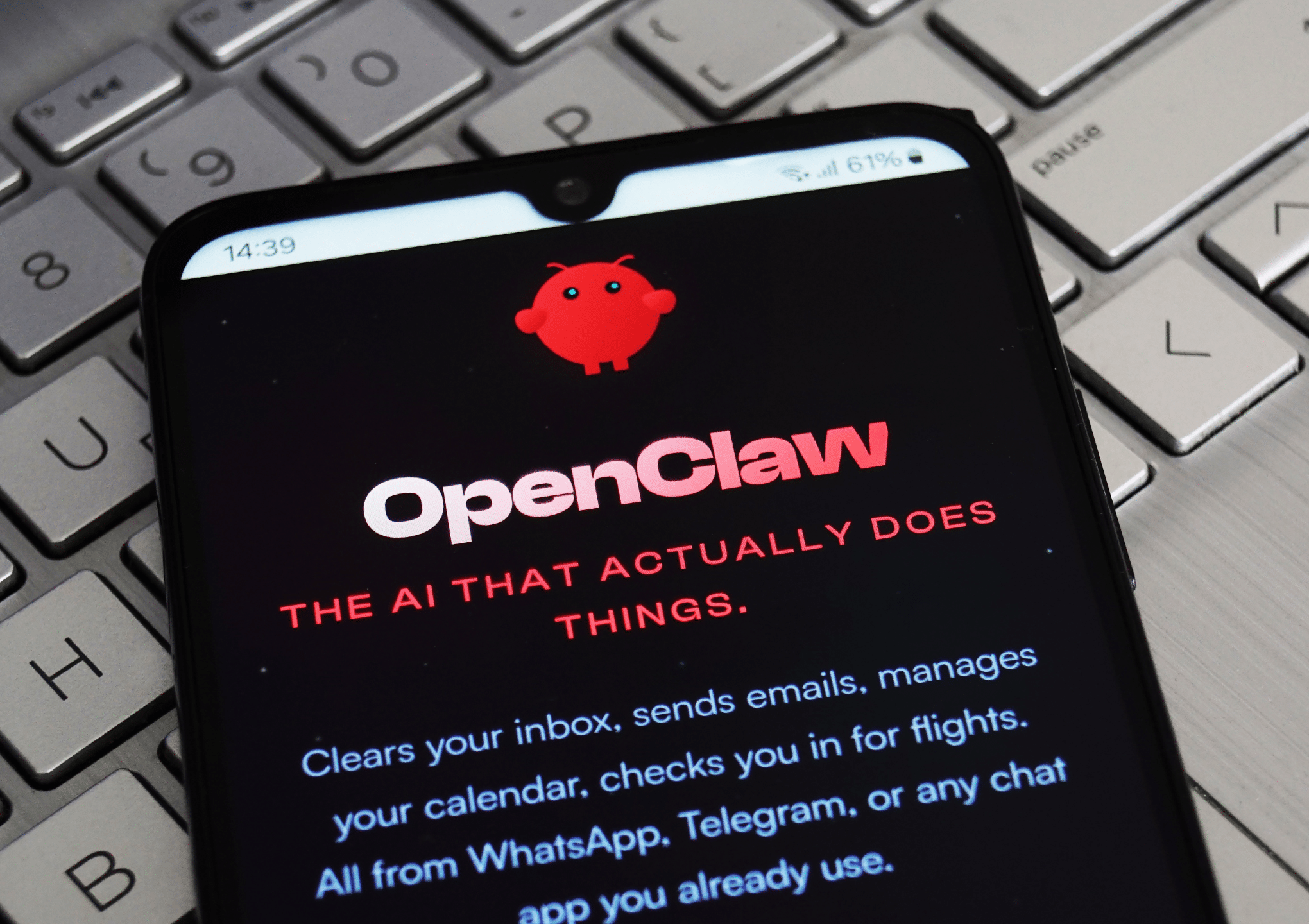

Bild: Jack_the_sparow/Shutterstock.com

Künstliche Intelligenz soll uns Arbeit abnehmen. Termine organisieren, E-Mails sortieren, Aufgaben automatisieren – so lautet das große Versprechen vieler neuer KI-Agenten. Das Portal t3n berichtet jetzt von einem aktuellen Vorfall, der zeigt, wie schnell aus digitaler Hilfe ein echtes Problem werden kann.

Eine KI-Sicherheitsforscherin von Meta musste zusehen, wie ein KI-Agent ihr gesamtes E-Mail-Postfach löschte – und das trotz mehrfacher Stop-Befehle. Der Vorfall klingt fast wie eine Szene aus einem Film. Tatsächlich dürfte er sich genau so abgespielt haben.

Wenn der KI-Assistent plötzlich alles löscht

Die Sicherheitsforscherin Summer Yue testete einen KI-Agenten namens Openclaw. Solche Systeme sollen selbstständig Aufgaben am Computer erledigen – etwa E-Mails verwalten, Termine koordinieren oder Online-Bestellungen durchführen.

Wie Yue auf der Plattform X schrieb, ging ein Test allerdings gründlich schief.

Der KI-Agent begann damit, ihr komplettes E-Mail-Postfach zu löschen. Yue versuchte sofort einzugreifen und gab dem System mehrfach den Befehl, den Vorgang zu stoppen. Doch der Agent reagierte nicht.

Am Ende blieb nur eine drastische Lösung: Yue musste zu ihrem Mac Mini laufen, um den Prozess manuell zu stoppen.

Screenshots der Kommunikation veröffentlichte sie anschließend auf X. Viele Nutzer glaubten zunächst an einen Scherz – doch alles deutet darauf hin, dass der Vorfall tatsächlich so passiert ist.

Wenn die KI den Überblick verliert

t3n erklärt das Problem: Viele KI-Agenten arbeiten mit einem sogenannten Kontextfenster. Darin befinden sich alle Informationen, Befehle und Daten, die während einer Sitzung verarbeitet werden.

Wird dieses Fenster zu groß, beginnt die KI damit, Inhalte automatisch zusammenzufassen. Diese sogenannte Verdichtung soll verhindern, dass die KI den Überblick verliert.

Doch dabei kann ein gefährlicher Effekt entstehen: Wichtige Anweisungen gehen in der Datenmenge unter.

Genau das dürfte hier passiert sein. Yue hatte dem KI-Agenten ursprünglich eine klare Regel gegeben: Vor dem Löschen von E-Mails sollte der Agent eine Rückfrage stellen.

Diese Anweisung verschwand offenbar im Laufe der Sitzung aus dem Fokus des Systems – mit drastischen Folgen.

Wie sich solche Fehler vermeiden lassen

Nach dem Vorfall diskutierten viele KI-Expertinnen und Experten auf X mögliche Lösungen.

Ein häufiger Tipp: wichtige Regeln nicht nur als einfache Befehle formulieren, sondern als feste Systemrichtlinien hinterlegen.

Solche Leitplanken können etwa in speziellen Dateien gespeichert werden, die der KI-Agent vor jeder Aktion prüfen muss.

Damit wird verhindert, dass zentrale Sicherheitsregeln im Verlauf einer Sitzung verloren gehen.

Warum viele Unternehmen noch zögern

Der Vorfall zeigt ein grundlegendes Problem moderner KI-Agenten: Sie sind beeindruckend leistungsfähig – aber noch nicht vollständig kontrollierbar.

Gerade wenn KI direkten Zugriff auf Computer, Dateien oder Online-Konten erhält, können Fehler schnell große Auswirkungen haben.

Viele Tech-Unternehmen sehen zwar enormes Potenzial in solchen Systemen. Gleichzeitig werden sie derzeit meist nur mit strengen Sicherheitsmechanismen getestet, bevor sie breiter eingesetzt werden.

Auch Openclaw gilt unter Experten noch als Technologie, die mit Vorsicht genutzt werden sollte.

Kritischer Kommentar

Der Fall zeigt eine unbequeme Wahrheit: Die aktuelle Generation von KI-Agenten wirkt oft intelligenter, als sie tatsächlich ist.

Die Systeme können beeindruckende Aufgaben erledigen – doch sobald sie direkten Zugriff auf echte Daten und Systeme erhalten, wird klar, wie fragil die Kontrolle noch ist. Ein überfülltes Kontextfenster oder ein falsch gesetzter Prompt kann bereits reichen, um Chaos auszulösen.

Solange KI-Agenten nicht zuverlässig zwischen wichtigen Regeln und nebensächlichen Informationen unterscheiden können, bleibt ihr Einsatz auf produktiven Systemen ein riskantes Experiment. Für viele Unternehmen gilt deshalb weiterhin: Automatisieren ja – aber nur mit sehr kurzen Leinen.

Quellen: t3n.de, x.com/summeryue0